Da hat die Technik in den letzten Jahren ziemliche Fortschritte gemacht. Vor sechs Jahren wurden schon mal Ergebnisse eines ähnlichen Versuches veröffentlicht, beim Vergleich merkt man, dass die KI dazugelernt hat.Guthwulf hat geschrieben: ↑5. Mär 2023, 12:48 Grad drüber gestolpert:

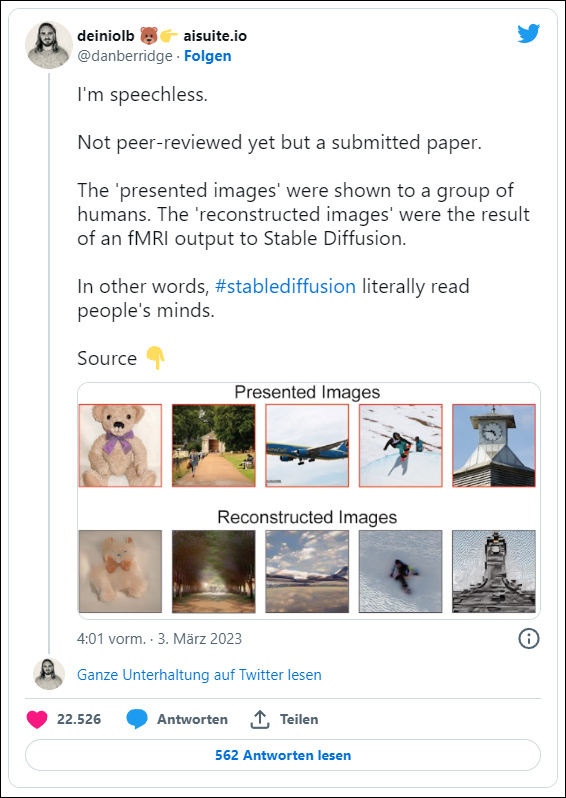

Mit Stable Diffusion: Forscher lesen menschliche Gehirnaktivität aus: "In dem Experiment wurden visuelle Bilder aus den Signalen funktioneller Magnetresonanztomographie rekonstruiert, nachdem Menschen ein Bild vorgelegt worden war, das sie sich genau anschauen sollten. Die Ergebnisse sprechen dabei für sich."

https://t3n.de/news/stable-diffusion-fo ... t-1538583/

Erscheint mir (ohne genauer drüber nachgedacht zu haben) auch nicht völlig unlogisch oder überraschend. Das neuronale Netz hat (noch) kein Bewußtsein und "versteht" damit auch nicht, was z.B. eine "Teekanne" ist, Es wurde nur darauf trainiert welche Art von Linien, Formen und Farben (aka Bilder) zu welchem Input passen. Welche Art von Input ist dafür erstmal egal, solange es konkret dafür trainiert hat. Man kann es anstatt auf Text Inputs also sicher auch auf MRI Inputs trainieren. Faszinierend ist es natürlich trotzdem

https://www.biorxiv.org/content/biorxiv ... 7.full.pdf